概述

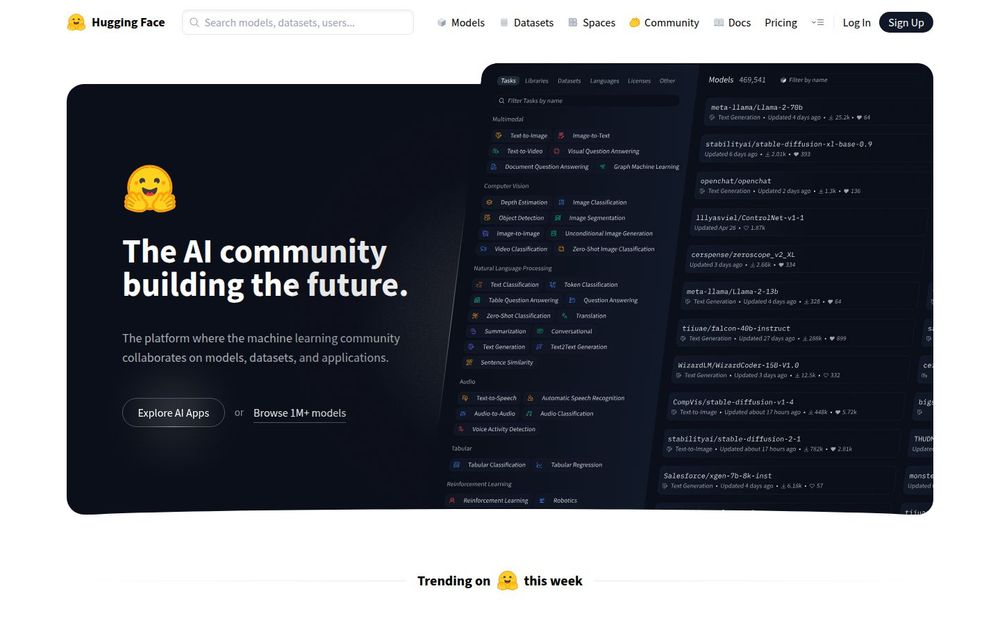

Hugging Face 是一个面向机器学习与人工智能的协作平台,致力于成为“机器学习的家园”。平台汇聚了大量开源模型、数据集和可交互应用(Spaces),并通过统一的 Hub、API 与库简化模型发现、共享、评估与部署流程。无论是研究人员、开发者还是企业团队,都可以在此托管资源、复现实验并快速将模型投入生产。

核心能力

- 模型库: 提供超过百万个预训练模型,覆盖语言模型、图像生成、语音合成等多种任务,便于直接下载或通过 API 调用。

- Spaces 应用: 支持基于 Gradio、Streamlit 等框架一键部署交互式应用,方便展示模型能力与快速原型搭建。

- 数据集中心: 聚合海量数据集并提供版本管理与元数据检索,支持研究复现与数据共享。

- 统一 API 与推理服务: 通过 Inference API 和 Inference Providers,用户可以用统一接口访问 45,000+ 模型,实现跨提供商的无缝推理。

- 开源工具栈: 包括 Transformers、Diffusers、Tokenizers、Accelerate 等多个流行库,覆盖训练、微调、推理与前端运行等环节。

主要功能(编号列表)

- 模型托管与版本控制: 在 Hub 上托管模型、代码与权重,并支持版本与权限管理,便于协作与复现。

- Spaces 可视化应用部署: 快速将模型打包为交互式演示,支持多人访问与演示场景。

- 统一推理与计费方案: 提供按需的 GPU 计费、Inference Endpoints 与企业级支持,便于生产环境部署。

- 开源生态与社区支持: 丰富的文档、教程与活跃社区,推动研究成果共享与工具链迭代。

- 多模态与跨平台支持: 覆盖文本、图像、音频、视频和 3D 等多种模态,支持浏览器端与云端运行。

推荐原因

Hugging Face 将模型发现、共享、部署与社区协作整合在同一平台,降低了从研究到产品化的门槛。对个人开发者而言,它是构建作品集与展示能力的捷径;对企业来说,则提供了可扩展的推理服务与企业级安全选项。其成熟的开源工具链与活跃生态,亦确保研究与工程实践之间有高效的桥梁。

适用场景与注意点

- 适合需要快速试验与展示模型能力的研究或产品原型。

- 对于生产部署,平台提供付费的计算与企业功能(如 SSO、审计日志与资源分组),但需评估成本与合规要求。

总结

Hugging Face 既是一个资源丰富的开源生态,也是一个面向生产与团队协作的商业平台。无论是探索最新模型、分享成果,还是在云端稳定部署推理服务,Hugging Face 都提供了便捷且成熟的工具链与社区支持。